Vertrauenswürdige KI (Trustworthy AI) – Verantwortungsvoll mit künstlicher Intelligenz umgehen

Künstliche Intelligenz verändert die Geschäftswelt grundlegend. Unternehmen setzen zunehmend auf automatisierte Entscheidungsprozesse, intelligente Datenverarbeitung und innovative KI-Anwendungen. Gleichzeitig steigen die Erwartungen von Kunden, Geschäftspartnern und Regulierungsbehörden an die Transparenz, Sicherheit und ethische Vertretbarkeit dieser Systeme. Wer künstliche Intelligenz in seiner Organisation einführt oder skaliert, steht vor der Aufgabe, diese nicht nur leistungsfähig, sondern auch vertrauenswürdig zu gestalten.

Gerade jetzt ist es entscheidend, den Anschluss an die KI-Transformation nicht zu verlieren. Unternehmen müssen sich aktiv mit der Integration und Beherrschung von KI auseinandersetzen, um langfristig wettbewerbsfähig zu bleiben.

Inhalte

Was bedeutet "vertrauenswürdige KI" konkret?

Vertrauenswürdige KI – auch im Englischen bekannt als Trusted AI oder Trustworthy AI – steht für die verantwortungsvolle Entwicklung und Nutzung von KI-Technologien. Sie vereint Aspekte wie Sicherheit, Datenschutz, Fairness und Transparenz und stellt sicher, dass KI-Systeme nachvollziehbare, gesellschaftlich akzeptierte und gesetzeskonforme Entscheidungen treffen können.

Unternehmen, die KI vertrauenswürdig einsetzen wollen, benötigen klare Leitlinien, Best Practices und ein funktionierendes Trusted AI Framework, das den gesamten KI-Lebenszyklus berücksichtigt – von der Entwicklung über das Training bis zur langfristigen Nutzung.

Dabei gewinnen auch technologische Plattformen und unternehmensweite Initiativen an Bedeutung, um vertrauenswürdige KI nachhaltig und skalierbar zu implementieren. Ein durchdachtes Konzept ist essenziell für die Integration der verschiedenen KI-Funktionen in bestehende Prozesse – unter Einhaltung der rechtlichen und gesellschaftlichen Anforderungen.

Definition und Relevanz von Trustworthy AI

Trustworthy AI bedeutet nicht nur die technische Funktionsfähigkeit von KI-Systemen, sondern auch deren gesellschaftliche und regulatorische Verträglichkeit. Während die allgemeine Definition grundlegende Prinzipien wie Fairness und Transparenz beschreibt, liegt der Fokus hier auf der praktischen Relevanz:

In sensiblen Bereichen – z. B. im Gesundheitswesen, in der Finanzbranche oder im öffentlichen Sektor – beeinflussen KI-Systeme täglich Entscheidungen mit weitreichenden Folgen. In jedem Bereich bestehen dabei spezifische Anforderungen an die Vertrauenswürdigkeit von KI, die sowohl organisatorische als auch technische Domänen betreffen.

Daher ist es entscheidend, dass diese Systeme zuverlässig, kontrollierbar und rechenschaftspflichtig agieren. Unternehmen, die auf vertrauenswürdige KI setzen, positionieren sich als verantwortungsvolle Akteure und verschaffen sich gleichzeitig regulatorische und wirtschaftliche Vorteile.

Warum Vertrauen ein Wettbewerbsfaktor wird

Vertrauen ist nicht nur eine soziale, sondern eine ökonomische Größe. Studien zeigen, dass Nutzer und Partner vermehrt auf die Integrität von KI-Anwendungen achten. Unternehmen, die ihre KI-Modelle erklären können, Entscheidungen transparent machen und Datenschutz garantieren, genießen einen deutlichen Vorteil am Markt.

Vertrauen reduziert nicht nur Unsicherheit, sondern erhöht auch die Nutzungsbereitschaft von KI-Systemen – sei es intern in der Belegschaft oder extern bei Kunden. Gerade bei Deep Learning Modellen, neuronalen Netzen und Large Language Models ist es entscheidend, auf Mechanismen der Fairness, Rechenschaftspflicht und Transparenz zu setzen. Die Fehlertoleranz der Nutzer gegenüber KI-Systemen ist dabei gering; wiederholte Fehler können das Vertrauen nachhaltig beeinträchtigen. So wird Vertrauen zu einem strategischen Asset im globalen Wettbewerb – mit konkretem wirtschaftlichem und gesellschaftlichem Wert.

Schlüsselprinzipien: Fairness, Transparenz, Erklärbarkeit

Vertrauenswürdige KI basiert auf grundlegenden Prinzipien und Eigenschaften wie Sicherheit, Ethik und Funktionalität, die den fairen, transparenten und erklärbaren Einsatz von KI-Systemen sicherstellen. Nur wenn Unternehmen diese Werte ernst nehmen und systematisch verankern, können sie das Vertrauen von Nutzer*innen, Behörden und der Gesellschaft gewinnen und langfristig halten.

- Fairness: Der Einsatz von KI darf nicht zu Benachteiligungen führen – weder bei der Auswahl von Bewerber*innen, der Kreditvergabe noch bei automatisierten Empfehlungen. Fairness bedeutet, systematische Verzerrungen in Trainingsdaten und Modellen zu identifizieren und auszugleichen.

- Transparenz: Unternehmen müssen offenlegen, wie KI-Systeme funktionieren, welche Daten verwendet werden und wie Entscheidungen zustande kommen. Diese Transparenz betrifft nicht nur die Entwicklungsteams, sondern vor allem die Nutzenden, die auf die Ergebnisse angewiesen sind.

- Erklärbarkeit: KI-Anwendungen müssen so gestaltet sein, dass ihre Entscheidungen verständlich sind – auch ohne tiefes technisches Vorwissen. Ansätze wie Explainable AI ermöglichen es, die Funktionsweise komplexer KI-Systeme (z. B. Sprachmodelle oder Deep Learning Netze) visuell und logisch nachvollziehbar zu machen.

Risiken & Reputationsgefahren im KI-Einsatz

Der Einsatz von KI-Systemen kann erhebliche Auswirkungen auf das Vertrauen von Kund*innen, Mitarbeitenden und der Öffentlichkeit haben – besonders dann, wenn Fehler auftreten oder Entscheidungen nicht nachvollziehbar sind. Unternehmen sollten frühzeitig KI-Risiken identifizieren und proaktiv steuern, um den neuen gesetzlichen Anforderungen gerecht zu werden und negative Folgen zu vermeiden.

Reputationsrisiken entstehen meist dann, wenn ethische oder rechtliche Grundsätze verletzt werden. Deshalb sind klare Regeln und ein vorausschauendes Risikomanagement essenziell, um die Integrität von KI-Anwendungen zu sichern.

Reputationsrisiken: Wie Vertrauen verloren geht

Vertrauen ist schnell verspielt – insbesondere im Zusammenhang mit automatisierten Entscheidungen, die persönliche oder geschäftskritische Auswirkungen haben. Wenn Nutzende das Gefühl haben, unfair behandelt oder nicht transparent informiert zu werden, schadet dies unmittelbar der Marke.

Beispiele aus der Praxis zeigen, wie algorithmische Diskriminierung oder intransparente Entscheidungsprozesse zu öffentlichen Skandalen und rechtlichen Konsequenzen geführt haben. Die Kombination aus KI und Datenschutz muss daher besonders sorgfältig gestaltet werden, um keine Angriffsfläche zu bieten.

Verantwortung & AI Governance

Ein zentrales Instrument zur Vermeidung von Reputationsrisiken ist ein durchdachtes AI-Governance-Konzept. Dieses umfasst klare Zuständigkeiten, verbindliche Leitlinien für Entwicklung und Einsatz von KI, eine kontinuierliche Bewertung potenzieller Risiken sowie Maßnahmen zur Qualitätssicherung. Unternehmen sollten ein Trusted AI Framework etablieren, das organisatorische, ethische und technische Aspekte zusammenführt und in der gesamten Organisation verankert ist, wobei insbesondere verschiedene technische und organisatorische Aspekten bei der Bewertung von KI-Governance berücksichtigt werden sollten.

Beispiele & Fehlentwicklungen

Fehlentwicklungen bei KI-Systemen sind keine Seltenheit – sie reichen von automatisierten Bewerbungsprozessen, die systematisch bestimmte Gruppen benachteiligen, bis hin zu Empfehlungssystemen, die durch unzureichende Datenqualität falsche oder problematische Inhalte verbreiten. Ein Beispiel hierfür ist ein KI-gestütztes Kreditbewertungssystem, das aufgrund verzerrter Trainingsdaten bestimmte Bevölkerungsgruppen benachteiligt. In vielen Fällen fehlt es an geeigneten Mechanismen, um solche Fehler rechtzeitig zu erkennen und zu korrigieren.

Regulatorik & rechtlicher Rahmen (AI Act & Co.)

Die gesetzlichen Rahmenbedingungen für den Einsatz von KI werden in Europa durch Verordnung (EU) 2024/1689 (den sogenannten "Artificial Intelligence Act") definiert – eine umfassende Regulierung, die klare Leitlinien und Anforderungen für vertrauenswürdige KI schafft. Vorschriften bilden dabei zentrale Rahmenbedingungen, die die Entwicklung und Umsetzung von Trustworthy AI steuern und absichern. Unternehmen müssen verstehen, welche Pflichten sich daraus ergeben und wie sich diese auf ihre KI-Strategien auswirken.

Überblick zum AI Act

Die europäische KI-Verordnung verfolgt einen risikobasierten Ansatz. Sie unterscheidet zwischen verbotenen, hochriskanten, begrenzt riskanten und minimal riskanten KI-Systemen. Für hochriskante Anwendungen – etwa in der kritischen Infrastruktur, bei der biometrischen Identifikation oder in der Personal- und Kreditvergabe – gelten strenge Auflagen: technische Dokumentation, Risikomanagement, menschliche Aufsicht und Transparenzpflichten. Unternehmen, die vertrauenswürdige KI etablieren wollen, sollten frühzeitig prüfen, ob ihre Anwendungen unter die Hochrisiko-Kategorie fallen und entsprechende Maßnahmen umsetzen.

Anforderungen an vertrauenswürdige KI aus Sicht des Gesetzgebers

Der AI Act macht deutlich: Vertrauen in KI entsteht nicht von selbst. Es braucht Prozesse und Kontrollen entlang des gesamten Lebenszyklus von KI-Systemen. Die Einhaltung der Anforderungen erstreckt sich dabei über alle Phasen des KI-Lebenszyklus – von der Konzeption bis zum Betrieb und Monitoring. Dazu gehören in etwa:

- Qualitätsgesicherte Trainings- und Testdaten:

Nur hochwertige, repräsentative und nicht-diskriminierende Daten schaffen die Grundlage für faire und verlässliche KI-Modelle. Schlechte Datenqualität führt zu systematischer Benachteiligung. - Dokumentierte Entscheidungsprozesse:

Jede Entscheidung eines KI-Systems muss technisch wie inhaltlich nachvollziehbar sein. Dokumentationen erleichtern Auditierungen und verbessern die interne Nachvollziehbarkeit. - Nachvollziehbarkeit und Transparenz gegenüber Nutzenden:

Nutzer*innen müssen verstehen können, wie und warum eine KI zu einem Ergebnis kommt. Das stärkt das Vertrauen und unterstützt informierte Entscheidungen. - Laufende Bewertung und Monitoring der Systemleistung:

KI-Systeme müssen kontinuierlich überwacht werden, um ihre Verlässlichkeit sicherzustellen und frühzeitig auf Abweichungen oder Fehler zu reagieren. - Verpflichtende Risikobewertungen:

Vor der Einführung von KI-Anwendungen müssen potenzielle Risiken strukturiert analysiert und bewertet werden. Nur so lassen sich geeignete Gegenmaßnahmen entwickeln.

Diese Anforderungen lassen sich nur mit einem robusten Governance-Konzept, technischer Umsetzung und geschulten Mitarbeitenden erfüllen.

-> Erfahren Sie in unserem Blogbeitrag, wie eine Risikoanalyse nach EU AI Act abläuft - Kerstin Harzendorf, erfahrene Juristin und Expert Consultant für Datenschutz gibt Einblicke in die Unternehmenspraxis.

Datenschutz & Mitarbeiterschulung

Datenschutz ist kein Nebenaspekt, sondern ein zentrales Element vertrauenswürdiger KI. Unternehmen müssen personenbezogene Daten rechtskonform verarbeiten, Risiken analysieren und technische sowie organisatorische Schutzmaßnahmen etablieren. Ein sicherer Umgang mit sensiblen Daten und maschinellen Lernverfahren ist dabei essenziell, um Datenschutz und Compliance zu gewährleisten.

Zusätzlich verlangt der AI Act, dass Mitarbeitende in der Lage sind, die eingesetzten KI-Systeme zu verstehen, zu überwachen und bei Bedarf einzugreifen. Schulungen, Awareness-Maßnahmen und klare Verantwortlichkeiten sind entscheidend, um die gesetzlich geforderte Rechenschaftspflicht sicherzustellen.

KI-Kompetenz-Schulung für Mitarbeitende und Unternehmen

KI-Kompetenz-Schulung für Mitarbeitende und Unternehmen

In unseren Schulungen über KI Kompetenz vermitteln wir Ihnen einen fundierten Überblick über alle Themen zu vertrauenswürdiger KI.

Anmeldung KI KompetenzschulungTechnische und organisatorische Voraussetzungen

Vertrauenswürdige KI entsteht nicht zufällig – sie muss technisch geplant, gesteuert und dauerhaft überprüft werden. Unternehmen benötigen ein stabiles Fundament aus technischer Infrastruktur, Sicherheitsstandards und datenethischer Praxis. Die Implementierung technischer und organisatorischer Maßnahmen bildet dabei die Grundlage für die Entwicklung und Integration vertrauenswürdiger KI-Lösungen. Diese Voraussetzungen sind entscheidend, um Risiken zu minimieren und das volle Potenzial von KI sicher und nachvollziehbar zu entfalten.

Erklärbare KI & technische Transparenz

Erklärbarkeit ist der Schlüssel zur Nachvollziehbarkeit von KI-Systemen. Mit Tools wie SHAP oder LIME lassen sich Entscheidungsprozesse – insbesondere bei Deep Learning Modellen oder komplexen Sprachmodellen – visuell darstellen und analysieren. Erklärungen zu KI-Systemen müssen dabei, ähnlich wie Bücher, auf die jeweilige Zielgruppe zugeschnitten sein, damit sowohl Laien als auch Fachleute die Inhalte verstehen können. Dadurch wird sichergestellt, dass KI-gestützte Entscheidungen nachvollziehbar, begründbar und überprüfbar bleiben – für Nutzende, Entwicklungsteams und Regulierungsbehörden gleichermaßen.

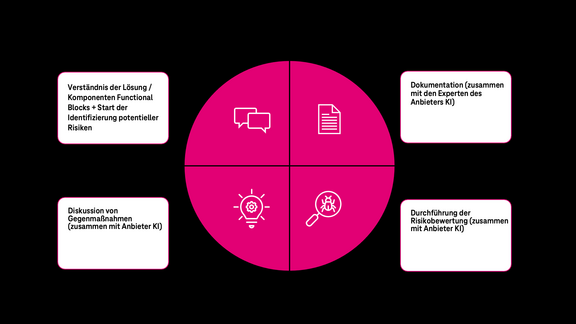

Sicherheitsmaßnahmen & Risikoanalyse

Die Einführung und Nutzung von KI-Systemen birgt sicherheitsrelevante Herausforderungen. Dazu zählen beispielsweise Angriffe auf Trainingsdaten (Data Poisoning), Manipulationen durch adversariale Eingaben, unbefugte Zugriffe auf Schnittstellen oder das Fehlverhalten komplexer Modelle bei unkontrollierten Inputs. Unternehmen müssen daher präventive und reaktive Maßnahmen treffen, um die Integrität und Sicherheit ihrer KI-Systeme zu gewährleisten.

- Zugriffskontrollen auf Trainings- und Produktivsysteme

- Verschlüsselung sensibler Daten

- Modellversionierung und revisionssichere Protokollierung

- Laufzeitüberwachung und strukturierte Reaktionspläne bei Anomalien

Eine strukturierte Risikoanalyse ist Voraussetzung, um Schwachstellen frühzeitig zu erkennen und geeignete Schutzmaßnahmen zu etablieren.

-> Mehr zu KI-Sicherheit und wie Sie Sicherheitsrisiken beim KI-Einsatz minimieren können

Schutzmechanismen & Datenmanagement

Datensicherheit und -qualität sind essenziell für vertrauenswürdige KI. Ein integriertes System, das sowohl technische als auch organisatorische und managementbezogene Komponenten umfasst, ist entscheidend, um Datenschutz und effektives Datenmanagement sicherzustellen. Unternehmen sollten folgende Aspekte berücksichtigen, um die Integrität, den Datenschutz und die technische Verlässlichkeit ihrer KI-Anwendungen langfristig zu gewährleisten. Neben diesen Maßnahmen ist die kontinuierliche Überwachung und der sichere Betrieb von KI-Systemen während ihres gesamten Lebenszyklus entscheidend, um Risiken frühzeitig zu erkennen und Compliance-Anforderungen zu erfüllen.

- Governance-Modelle zur Klassifikation und Verarbeitung sensibler Daten: Es braucht klare Richtlinien, welche Datenarten wie verarbeitet werden dürfen – insbesondere bei vertraulichen oder geschützten Informationen. So lassen sich Datenschutzverletzungen frühzeitig vermeiden.

- Transparente Regeln für die Datennutzung, insbesondere bei personenbezogenen Informationen: Nutzende müssen darüber informiert werden, wie ihre Daten erhoben, gespeichert und verarbeitet werden. Transparente Prozesse fördern die Akzeptanz und senken regulatorische Risiken.

- Mechanismen zur Löschung, Anonymisierung oder Aggregation von Trainingsdaten: Für viele Anwendungsfälle ist es nötig, Trainingsdaten zu bereinigen oder zu abstrahieren. Damit lassen sich Rückschlüsse auf Einzelpersonen verhindern und gesetzliche Vorgaben erfüllen.

- Nachvollziehbarkeit aller Eingaben und Verarbeitungsschritte: Jede Eingabe und jeder Verarbeitungspfad sollte dokumentiert werden, um Fehlerquellen zu erkennen und bei Bedarf Verantwortlichkeiten zu klären – z. B. im Rahmen von Audits oder Prüfungen.

Datenschutzberatung für Unternehmen

Datenschutzberatung für Unternehmen

Wir unterstützen Sie dabei, Ihre KI-Projekte sicher und datenschutzkonform zu gestalten. ✓ individuelle Beratung ✓ Risiko-& Datenschutzfolgeabschätzung ✓ Awareness-Schulung für Mitarbeiter

Mehr Informationen zur KI-DatenschutzberatungUmsetzung in der Praxis – So gelingt vertrauenswürdige KI

Eine vertrauenswürdige KI-Strategie wird erst dann wirksam, wenn sie von der Theorie in die unternehmerische Praxis überführt wird. Die praktische Anwendung von technischen und organisatorischen Maßnahmen ist dabei entscheidend, um Trustworthy AI im Unternehmensumfeld erfolgreich zu integrieren und die Vertrauenswürdigkeit der KI in realen Szenarien sicherzustellen. Dazu gehört neben klarer Planung vor allem die Verankerung in Organisation, Prozessen und Kultur. Unternehmen, die KI erfolgreich einsetzen wollen, brauchen eine belastbare Struktur, zertifizierbare Standards und qualifizierte Teams.

Strategische Integration & Rollenklärung

Verantwortungsvolle KI erfordert ein abgestimmtes Zusammenspiel von Business, IT, Recht und Ethik. . Für eine erfolgreiche Integration von Trustworthy AI ist eine enge Zusammenarbeit zwischen verschiedenen Abteilungen und Teams unerlässlich, um den Austausch und die Koordination zwischen Mensch und KI zu fördern. Unternehmen sollten Rollen wie „AI Product Owner“, „AI Ethics Officer“ oder „Data Steward“ definieren und Verantwortlichkeiten klar zuweisen. Eine unternehmensweite KI-Strategie sorgt dafür, dass nicht nur technologische, sondern auch ethische und rechtliche Dimensionen konsequent berücksichtigt werden.

-> Mehr zum Thema in unserer Podcast-Folge: "Digitale Ethik: Welche Spielregeln brauchen wir für die Digitalisierung?"

Zertifizierungen & Implementierungsansätze

Normen wie die ISO/IEC 42001 helfen Organisationen dabei, KI-Prozesse nachvollziehbar und überprüfbar zu machen. Verschiedene Methoden werden eingesetzt, um regulatorische und ethische Anforderungen bei der Implementierung von Trustworthy AI zu erfüllen. Zertifizierungen stärken das Vertrauen von Kunden und Partnern in die eingesetzten Technologien und schaffen eine verlässliche Grundlage für Governance und Compliance.

Zur Umsetzung eignen sich praxisnahe Frameworks und branchenübergreifende Leitlinien, die helfen, ethische, rechtliche und technische Anforderungen systematisch zu verankern und Best Practices zu etablieren – unabhängig von einzelnen Anbietern.

Enablement & Schulungen für Teams

Damit KI verantwortungsvoll genutzt werden kann, müssen Teams gezielt qualifiziert und kontinuierlich weitergebildet werden. Das umfasst nicht nur klassische Schulungsformate, sondern auch die Etablierung einer organisationseigenen Lern- und Fehlerkultur. Technische Teams sollten in der Lage sein, Risiken in KI-Modellen zu erkennen, Bias zu identifizieren und Datenschutzanforderungen operativ umzusetzen. Fachabteilungen benötigen ein Verständnis für Einsatzgrenzen, Wirkprinzipien und Kontrollpflichten.

Trainings, Guidelines, praxisorientierte Workshops und kontinuierliches Lernen sind essenziell. Inhalte wie „KI und Datenschutz“, „Fairness in Modellen“, „Technische Risiken und Mitigationsstrategien“ oder „Grundlagen von Explainable AI“ sollten integraler Bestandteil aller Qualifizierungsmaßnahmen sein – abgestimmt auf Rolle, Verantwortung und technologische Reife der Organisation.

Business Case: Vertrauen als strategischer Vorteil

Vertrauen in KI zahlt sich aus – nicht nur ethisch, sondern auch wirtschaftlich. Eine fundierte Konzeption ist dabei entscheidend, um die erfolgreiche und nachhaltige wirtschaftliche Nutzung von Trustworthy AI sicherzustellen. Unternehmen, die KI nachvollziehbar, datenschutzkonform und transparent einsetzen, steigern ihre Markenreputation, gewinnen Kundenvertrauen und stärken ihre Position im Wettbewerb.

Vertrauen als Differenzierungsmerkmal

Gerade in gesättigten Märkten ist Vertrauenswürdigkeit ein echtes Unterscheidungsmerkmal. Kunden, Investoren und Partner achten zunehmend auf die verantwortungsvolle Nutzung von KI. Das Vertrauen in KI wird maßgeblich durch die positive Interaktion zwischen Menschen und KI-Systemen beeinflusst. Wer proaktiv kommuniziert, nachvollziehbar dokumentiert und auditierbare Standards vorweisen kann, hebt sich positiv ab.

Kundenerwartungen & Compliance

KI-Systeme müssen nicht nur leistungsfähig, sondern auch gesetzeskonform und nachvollziehbar sein. Dabei ist es entscheidend, dass ein KI-System so gestaltet wird, dass es regulatorische Anforderungen zuverlässig erfüllt. Unternehmen, die regulatorische Anforderungen wie den AI Act frühzeitig umsetzen und transparente Prozesse schaffen, erfüllen nicht nur die Erwartungen der Behörden, sondern auch die ihrer Kundschaft.

Warum sich Investitionen in Trusted AI lohnen

Unternehmen, die in vertrauenswürdige KI investieren, sichern sich nicht nur regulatorische Stabilität, sondern auch klare wirtschaftliche Vorteile. Eine Übersicht über die wirtschaftlichen und strategischen Vorteile von Trustworthy AI unterstützt Unternehmen dabei, fundierte Investitionsentscheidungen zu treffen. Die folgenden Effekte machen Trusted AI zu einem strategisch sinnvollen und nachhaltigen Investitionsfeld:

- Langfristige Risikominimierung: Rechtssichere KI-Systeme vermeiden Datenschutzverstöße, Diskriminierung und Reputationsschäden. Das reduziert nicht nur juristische Risiken, sondern schützt auch die Marke.

- Höhere Effizienz und Qualität: Der Einsatz etablierter Standards und nachvollziehbarer Prozesse verbessert die Qualität der Entscheidungen und spart Zeit bei Prüfung, Wartung und Skalierung von KI-Lösungen.

- Glaubwürdige Positionierung am Markt: Unternehmen, die vertrauenswürdige KI transparent kommunizieren und konsequent umsetzen, differenzieren sich sichtbar vom Wettbewerb und stärken ihre Marke.

- Vertrauensgewinn bei Stakeholdern: Vom Vorstand über Mitarbeitende bis zur Kundschaft – alle Beteiligten profitieren, wenn KI ethisch, sicher und verständlich funktioniert. Dieses Vertrauen wirkt sich direkt auf Kaufentscheidungen, Loyalität und Mitarbeiterbindung aus.

Fazit: Vertrauen in KI ist kein Zufall – sondern Strategie

Vertrauenswürdige KI ist mehr als ein technisches Ziel – sie ist ein strategisches Leitprinzip für verantwortungsvolle Digitalisierung. Unternehmen, die auf Fairness, Transparenz, Sicherheit und ethische Leitlinien setzen, schaffen nicht nur Akzeptanz bei Kund*innen, sondern stärken auch ihre eigene Innovations- und Wettbewerbsfähigkeit.

Mit einem strukturierten Ansatz, klarer Governance und qualifizierten Teams lassen sich Chancen von KI realisieren, ohne gesellschaftliches Vertrauen zu verspielen. Trusted AI bedeutet: Technologie gestalten, statt nur verwalten – und Verantwortung übernehmen, wo sie zählt.

FAQ – Häufige Fragen zur vertrauenswürdigen KI

Was genau ist vertrauenswürdige KI?

Vertrauenswürdige KI bezeichnet KI-Systeme, die sich durch ethische, technische und rechtliche Integrität auszeichnen. Sie operieren nachvollziehbar, diskriminierungsfrei, sicher und unter Achtung der Privatsphäre. Solche Systeme wurden mit geeigneten Daten trainiert, sind robust gegenüber Manipulation und ermöglichen es Nutzenden, Entscheidungen zu verstehen und ggf. zu hinterfragen. Ziel ist es, menschenzentrierte Technologien zu schaffen, die gesellschaftlichen Mehrwert bieten und Verantwortung nicht auf Maschinen abwälzen.

Welche Pflichten ergeben sich aus dem AI Act?

Der europäische AI Act klassifiziert KI-Systeme nach ihrem Risikopotenzial: von minimalem Risiko (z. B. Spamfilter) bis hin zu hohem Risiko (z. B. KI in kritischer Infrastruktur, HR oder Kreditvergabe) und verbotenen Praktiken (absichtlich manipulative Techniken). Für Hochrisiko-Anwendungen gelten verbindliche Pflichten:

- Durchführung einer Risikobewertung

- Technische Dokumentation

- Transparente Kommunikation gegenüber Nutzenden

- Einrichtung eines Qualitäts- und Überwachungssystems

- Registrierung in einer EU-Datenbank

Diese Pflichten sind mit umfassenden Anforderungen an Organisation, Prozesse, Datenmanagement und menschliche Aufsicht verbunden.

Welche Rolle spielt der Datenschutz?

Datenschutz bildet eine der tragenden Säulen vertrauenswürdiger KI. Die Verarbeitung personenbezogener Daten durch KI muss mit den Prinzipien der DSGVO in Einklang stehen: Rechtmäßigkeit, Zweckbindung, Datenminimierung, Transparenz, Integrität und Vertraulichkeit. Auch Betroffenenrechte – etwa auf Auskunft, Widerspruch oder Löschung – müssen gewährleistet bleiben. Ein modernes Datenschutzmanagement, das technische (z. B. Pseudonymisierung) und organisatorische Maßnahmen umfasst, ist unverzichtbar – gerade bei automatisierten Entscheidungen oder Profiling.

Wie lässt sich Vertrauen technisch umsetzen?

Technisches Vertrauen entsteht durch den gezielten Einsatz erklärbarer, sicherer und auditierbarer Systeme. Dazu zählen u.a.:

- Explainable AI (XAI): Modelle, die Entscheidungsprozesse für Fachabteilungen und Endnutzer*innen nachvollziehbar machen

- Monitoring & Logging: Lückenlose Protokollierung von Entscheidungen zur Nachvollziehbarkeit und Auditierbarkeit

- Bias-Detection & Fairness-Kontrollen: Identifikation und Korrektur systematischer Verzerrungen

- Robustheit & Sicherheit: Absicherung gegen adversariale Angriffe, Systemmanipulation und Datenlecks

- Human-in-the-loop-Konzepte: Einbindung menschlicher Expertise in kritische Entscheidungsprozesse

Diese Maßnahmen stärken das Vertrauen auf allen Ebenen – intern wie extern.